Դիփֆեյք․ երբ ստեղծում են մեր ինքնության պատրանքը, կեղծում՝ ձայնն ու պատկերը

Հաղորդաշարեր

25.12.2023 | 20:15

Դժվար է, բարդ է, անհասկանալի է, չեմ կարող կողմնորոշվել․․․ Մոտավորապես այսկերպ կարելի է բնորոշել այն իրավիճակները, երբ մենք տեսնում, դիտում, կարդում ենք մի բան, բայց զգում ենք մեկ ալ բան։ Արհեստական բանականությունն ու կեղծ տեղեկություն գեներացնող տեխնոլոգիական լուծումներն է՛լ ավելի են բարդացրել մեր կյանքը թվային և առցանց աշխարհում։

Մանիպուլյացիաներն ու կեղծ նորությունները մեծ թափով շարունակում են իրենց բացասական ազդեցությունն ունենալ հանրային կյանքի ամենատարբեր ոլորտների վրա, սկսած առողջապահությունից, մինչև անվտանգություն և քաղաքականություն։

Եկե՛ք փոքր-ինչ ծանոթանանք թվային աշխարհի մանիպուլյացիոն նորարարական այս գործիքին, որը կոչվում է դիփֆեյք, կամ, այլ կերպ ասած և ուղիղ թարգմանությամբ՝ խորը կեղծիք և ուսումնասիրենք մի քանի հետաքրքրաշարժ օրինակներ։

Այս մեթոդի մասին արտահայտվելիս առավել մատչելի լինելու համար կարելի է ասել, որ այն կլոնավորում է պատկերն ու ձայնը։

Դիփֆեյքերն առավել մեծ տարածում ունեն արագ սպառվող և տարածվող սոցիալական մեդիա հարթակներում, որոնցից է TikTokը։ Սակայն պետք է ընդգծել, որ TikTok-ի արագ տարածումն աշխարհում նպաստեց այնպիսի ձևաչափերի ստեղծմանը, որոնք այսօր առավել հայտնի են որպես «Ռիլ»-եր (Reels), կամ «Շորթ»-եր (Shorts): Ռիլերը տեսանյութեր են, որոնք, սովորաբար, 15 վայրկյանից մինչև հինգ րոպե տևողությամբ մեդիա բովանդակություններ են պարունակում։ Դեռևս 2015-ին «Մայքրոսոֆթ» ընկերության կողմից իրականացրած հետազոտությունը ցույց էր տվել, որ Z սերնդի (1996-2010 թթ․ ժամանակահատվածում ծնվածները) շրջանում տեսանյութի առաջին 8 վայրկյանները վճռորոշ դերակատարում ունեն՝ օգտատերը կշարունակի՞ դիտել այն, թե՞ կթերթի և կանցնի առաջ։ Այժմ այս վիճակագրությունը փոխվել է և նշանակալի դերակատարում ունեն առաջին 3-5 վայրկյանները։ Դիփֆեյքերը նաև հաշվի են առնում այս հանգամանքը և մշակում ու գեներացնում են այնպիսի բովանդակություններ, որոնք ոչ միայն կգրավեն օգտատիրոջ ուշադրությունը, այլև շարունակաբար կպահեն նրան էկրանի առջև՝ «ստիպելով» շարունակել թերթել։

Ավելին, ալգորիթմները հաշվարկում են մեր հետաքրքրության շրջանակն ու մեզ առաջարկում են համանման տեսանյութեր։ Դիտեցի՞ր մեկ դիփֆեյք։ Այժմ ալգորիթմը քեզ ճանաչում է որպես ֆեյք նորություններ սպառողի, և սոցիալական ցանցը կշարունակի քեզ առաջարկել բազմաթիվ այլ տեսանյութեր, որոնք ունեն համանման բովանդակություն՝ այդպիսով ժամեր շարունակ պահելով էկրանի առջև։ Այս մասին կխոսենք առանձին, իսկ հիմա վերադառնանք դիփֆեյքերին։

Եթե նախկինում դիփֆեյքեր մշակելը պահանջում էր արհեստավարժություն և այն ստեղծելը տեխնոլոգիական գուրուի ձեռքի աշխատանք էր, ապա այն հիմա առավել մատչելի է և մի քանի դոլարով հնարավոր է բաժանորդագրվել առցանց ծառայությունների, որոնք կտրամադրեն անհրաժեշտ գործիքակազմը՝ հեշտորեն և արագորեն դիփֆեյք ստեղծելու համար։ Այս զարգացումն առաջ է քաշում մի շարք մարտահրավերներ, ուստի մենք՝ սոցիալական մեդիայի օգտատերերս, պետք է առավել զգոն ու ուշադիր լինենք սոցիալական ցանցերում օրեցօր սպրդվող տեղեկատվության նկատմամբ։

Այդուհանդերձ չենք կարող չնշել, որ դիփֆեյքերը ոչ միայն վնասելու միտում ունեն, այլև՝ աշխարհը նորովի բացահայտելու, պատմությունը և մշակույթը վերագնահատելու և ստեղծագործականության սահմանները կոտրելու մեծ ներուժ։

Ստորև ներկայացված են մի քանի իրական դեպքեր, որոնք առավել պարզ կներկայացնեն դիփֆեյքերի կիրառման եղանակներն ու նպատակները։

Դիփֆեյքերը Հայաստանում և աշխարհում՝ քաղաքականությունից մինչև արվեստ, մշակույթ և գիտություն․

Քեյս 1-ին.

2018-ի սեպտեմբերին հայաստանյան մեդիատիրույթում տարածում գտավ 6 վայրկյան տևողությամբ մի տեսանյութ, որտեղ այդ ժամանակ ՀՀ առողջապահության նախարար հանդիսացող Արսեն Թորոսյանն ինքն իրեն անվանում էր «գիժ», «կատարյալ աննորմալ»։ Այն արագորեն լայն տարածում գտավ սոցիալական մեդիայի հարթակներում՝ ունենալով տասնյակ հազարավոր դիտումներ։ Իհարկե, սա դիփֆեյքի ոչ այնքան հմուտ կիրառում էր, քանի որ պատկերի կլոնավորումն այնքան էլ հաջող չէր, իսկ ձայնն առհասարակ կլոնավորված չէր։ Այդուհանդերձ շատերը հավատացել էին տեսանյութի իսկությանն ու արտահայտել իրենց վրդովմունքը սոցիալական ցանցերում տարածված տեսանյութի մեկնաբանություններում։

Քեյս 2-րդ․

Քաղաքական ամենաուշագրավ դիփֆեյքերից մեկը վերաբերում է ԱՄՆ նախկին նախագահ Բարաք Օբամային: 2018-ին Buzzfeed-ը և ռեժիսոր Ջորդան Փիլը ստեղծեցին Օբամայի դիփֆեյք տեսահոլովակը, օգտագործելով Փիլի ձայնը, որպեսզի նախկին նախագահն ասի այնպիսի բաներ, որոնք իրականում երբեք չի ասել: Այս դիփֆեյքը ստեղծվել է ապատեղեկատվության տարածման դեմ պայքարի նպատակով՝ դիփֆեյքի տեխնոլոգիայի հնարավոր վտանգները ցուցադրելու և լայն հասարակությանը հասցնելու համար։ Այն լայնորեն լուսաբանվել է համաշխարհային լրատվամիջոցների կողմից:

Քեյս 3-րդ․

Google-ը և Universal Music-ը որոշել են արտոնագրել երաժիշտների ձայները՝ deepfake թրեքների հեղինակներից գումար գանձելու և չարտոնված ստեղծագործությունների միջոցով կոմերցիոն գործընթացները կանխելու նպատակով:

Ավելի վաղ Universal Music-ը հեռարձակողներին խնդրել էր արգելափակել ծրագրավորողների մուտքը երաժշտական կատալոգներ, եթե նրանք օգտագործում են դրանք արհեստական բանականությունը մարզելու համար: Google-ը և Universal Music-ը մեկնարկել են մի գործընթաց, որով փորձում են երաժիշտների ձայներն ու «մեղեդիները» լիցենզավորել։

Ահա դիփֆեյքով ստեղծված երգերից մեկը (Drake Heart on my sleeve Ft The Weeknd), որտեղ ձայները նման են Դրեյքին և The Weeknd-ին։ Այս իրադարձությանն անդրադարձել էին անգամ միջազգային հեղինակավոր պարբերականները, այդ թվում նաև BBC-ն։ Ավելի ուշ Universal Music-ը Apple Music-ին, Spotify-ին և այլ հոսքային ծառայություններին խնդրել է հեռացնել արհեստական բանականության կողմից ստեղծված երաժշտությունը։ Financial Times նշում է, որ նոր արտադրանքը կամրապնդի Google-ի դիրքերը Microsoft-ի հետ մրցակցության մեջ, որը սերտորեն համագործակցում է OpenAI-ի հետ:

Քեյս 4–րդ․

Դեռ 2022-ին Apple-ը մշակել է «NeuMan» անունով նեյրոնային ցանց, որը մարզված է կարճ տեսանյութերի ուղղությամբ և կարող է մշակել դիփֆեյք տեսանյութեր։ Նյարդային ցանցը վարժեցնելու համար բավական է տեսախցիկով նկարահանված 10 վայրկյանանոց տեսանյութի օրինակ։ Ծրագիրը տեսանյութից հանում է մարդուն և շրջակա միջավայրի պատկերը։ Այնուհետև «NeuMan»-ը սինթեզում է նույն կերպարին՝ մշակելով այլ տեսանյութ։ Նոր տեսահոլովակներն ավելի քիչ հստակություն ունեն, բայց ընդհանուր առմամբ, դրանք նման են անորակ, սակայն իրական կադրերի:

Քեյս 5-րդ․

Business Insider-ն անդրադարձել է արհեստական բանականության կարողություններին՝ Վինսենթ վան Գոգի գեղարվեստական հանճարի օրինակով։ Գերմանիայի «Բեթգե» լաբորատորիայի գիտնականները պարզել են, թե ինչպես է ազդեցիկ նկարիչը աշխարհը մեկնաբանել՝ օգտագործելով արհեստական բանականության (AI) համակարգ, որը կարող է սովորել ցանկացած նկարչի ոճը, ինչպես Վան Գոգի ստեղծագործությանը բնորոշ պտույտներն ու կետերը, և կրկնել այն ուրիշների համար։ Բաց աղբյուրների ամսագրում հրապարակված հոդվածի առաջատար ասպիրանտ Լեոն Գաթիսի խոսքով, այն առաջին արհեստական նյարդային համակարգն է, որը հասնում է պատկերի բովանդակության տարանջատմանը ոճից: Սա անելու համար արհեստական բանականության համակարգին պետք էր նախ «սովորեցնել» հայտնի նկարի առանձնահատկությունները՝ նախքան այն կրկնելը։ Գիտնականները նրան հանձնարարել են վերլուծել Վան Գոգի ամենահայտնի նկարը՝ «Աստղային գիշեր»-ը:

Քեյս 6–րդ․

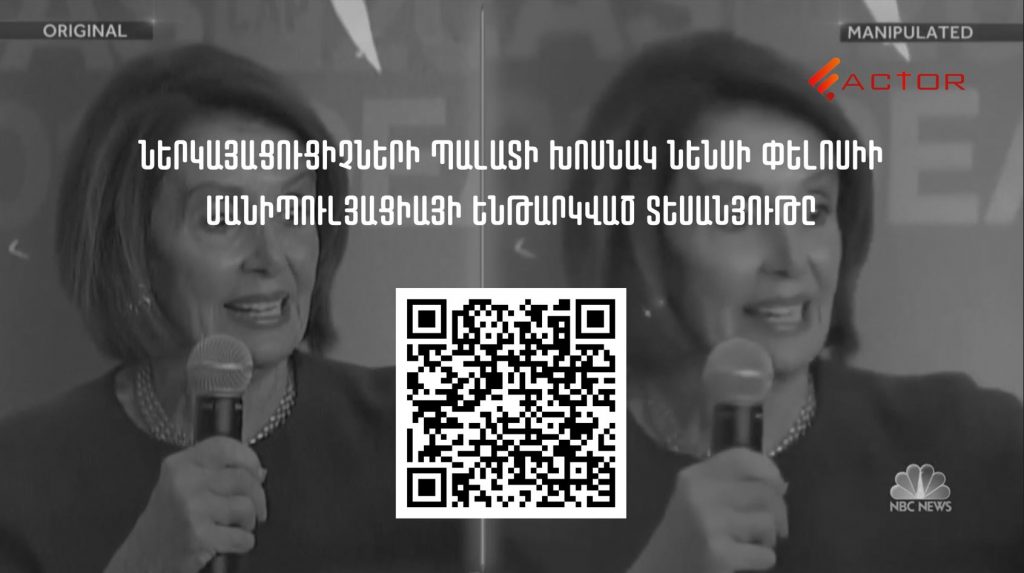

Դիփֆեյքի տեխնոլոգիայի բացասական ազդեցությունը ցուցադրող մեկ այլ նշանակալի դեպք վերաբերում էր ԱՄՆ Ներկայացուցիչների պալատի խոսնակ Նենսի Փելոսիի մանիպուլյացիայի ենթարկված տեսանյութին (2019 թվական): Այն պարզապես դանդաղեցրեց միջոցառման ժամանակ Փելոսիի ելույթի կադրերը՝ ստեղծելով կեղծ տպավորություն, որ նա շփոթեցնում է իր խոսքերով լսարանին, և ինքը նույնպես շփոթվում է, հետևաբար, ստեղծելով երևակայական վիճակ, իբրև, Փելոսին հարբած կամ վատառողջ է:

Այս տեսանյութը զգալի տարածում գտավ և տասնյակ միլիոնավոր դիտումներ ունեցավ սոցիալական մեդիայում՝ մոլորեցնելով շատ դիտողների և անհանգստություն առաջացնելով, թե ինչպես կարելի է օգտագործել դիփֆեյք տեխնոլոգիան համոզիչ կեղծիքներ ստեղծելու համար: Այս միջադեպն ընդգծեց հանրային կարծիքի վրա ազդելու և անհատներին վարկաբեկելու ներուժը, հատկապես քաղաքական ասպարեզում, առաջացնելով լուրջ հարցեր թվային դարաշրջանում՝ վստահության և ճշմարտության պահպանման մարտահրավերների վերաբերյալ:

Կալիֆոռնիայի Բերքլիի համալսարանի համակարգչային գիտության պրոֆեսոր Հանի Ֆարիդը CBS News-ի լրագրող Ջեֆ Պեգեսին հետ զրույցում նշել է, որ այս տեսանյութը սառցաբեկորի միայն գագաթն է, տեսանյութերն ու պատկերները կարելի է առավել շահարկել:

Քեյս 7-րդ․

1993 թվականից ի վեր Մեծ Բրիտանիայի թագուհի Էլիզաբեթ երկրորդի սուրբծննդյան շնորհավորական ուղերձն ամեն տարի կանոնավոր կերպով հեռարձակվել է ինչպես բրիտանական, այնպես էլ միջազգային լրատվամիջոցների կողմից։

2020 թվականին այս ավանդույթը խախտվեց բրիտանական «Channel 4»-ի հեռարձակմամբ, որտեղ ոչ միայն տարբերվում է բովանդակությունը, այլև դրա փաթեթավորումը, քանի որ թագուհու ուղերձին հաջորդում է պարը վերջինիս կատարմամբ։

Ձայնագրության ավարտին «թագուհին» խոսում է վստահության խնդրի մասին և նշում է․ «Արդյոք այն, ինչ մենք տեսնում և լսում ենք, միշտ ա՞յն է, ինչ թվում է»:

Ըստ հեռարձակողի սա հանրային իրազեկմանն ուղղված արշավ էր, քանի որ անհրաժեշտություն կար հասարակությանն իրազեկելու արհեստական բանականության և թվային այլ տեխնոլոգիաների միջոցով ստեղծվող, մշակվող և գեներացվող ապատեղեկատվության և դիփֆեյքի վտանգների մասին։

Ամփոփում

Տեխնոլոգիաները գալիս են աշխարհը փոխելու։ Միայն թե մարդկանցից է կախված․ աշխարհը կփոխվի դեպի ավելի լա՞վը, թե՞ վատը։ Արհեստական բանականության և տեխնոլոգիական լուծումների միջոցով գեներացվող բովանդակություններն ու մեդիա նյութերը կարող են ծառայել հասարակության կրթությանը, մշակույթի արժևորմանը, գիտության խթանմանն ու սոցիալական շահին։

Անկախ ամեն ինչից, մեր՝ թվային աշխարհի մարդկանց պարտքն է լինել իրազեկված, քանի որ պատմությունը կեղծվել է անցյալում, այն կեղծվում է հիմա և կեղծվելու է նաև ապագայում։ Մեր խնդիրն է վերլուծել տեղեկությունները և կատարել եզրակացություններ, որոնք հիմնված կլինեն գիտելիքն ու իրականությունը վավերացնելու մեր փորձի հիման վրա։

Դե ինչ, դուք դեռ հավատո՞ւմ եք ձեր աչքի տեսածին, թե՞ այն հավելյալ ստուգելու կարիք կա։

Հեղինակ՝ Ալեքսանդր Մարտիրոսյան